LLM向けB+-tree の真面目な研究

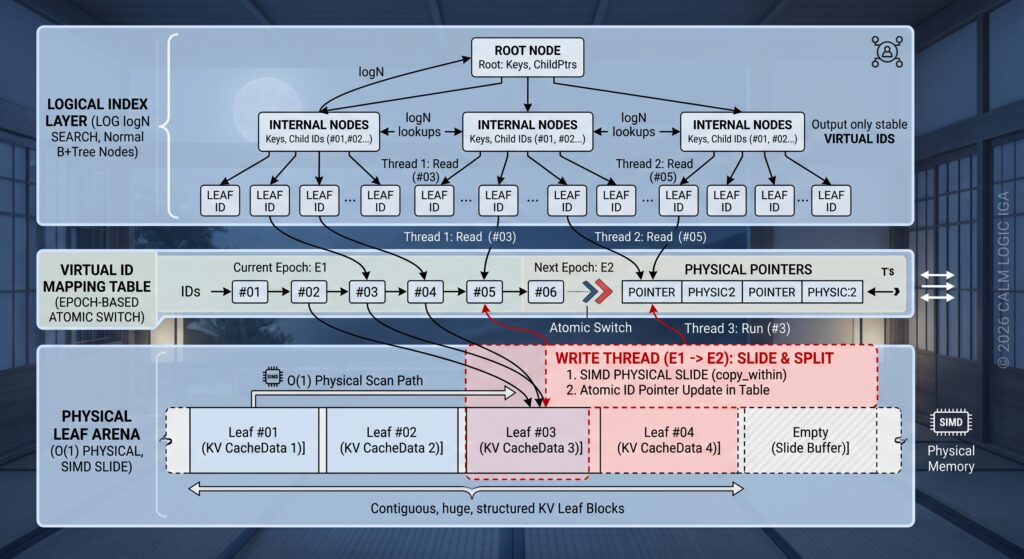

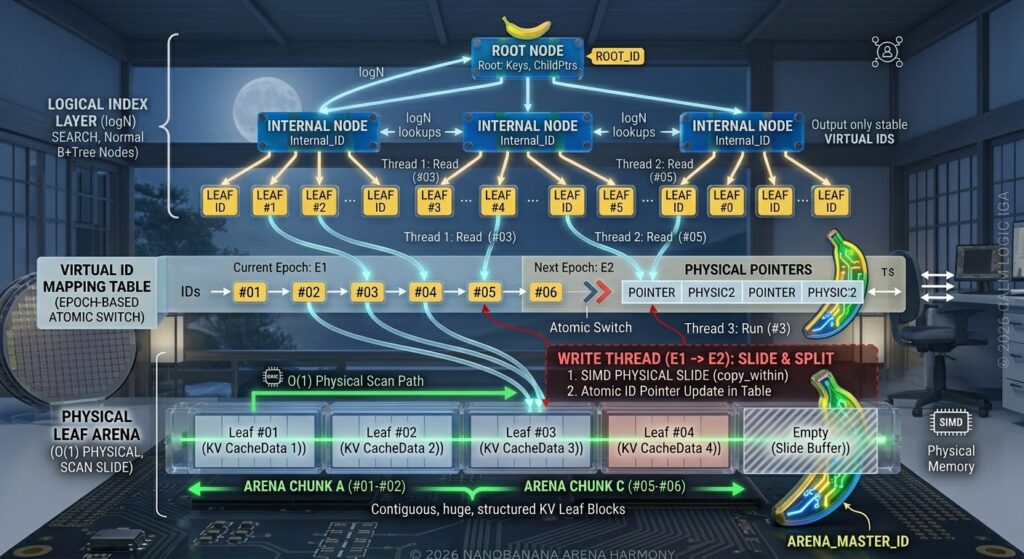

[ 中間ノード (Internal Node) ]

Keys: [ 100, 200 ]

Children ID: [ #01, #02, #03 ] 👈 ここは物理ポインタじゃなく「仮想ID」w

| | |

+———-+———-+

|

[ 仮想変換テーブル (Virtual Address Table) ]

#01: ptr -> [ リーフ A の物理アドレス ]

#02: ptr -> [ リーフ B の物理アドレス ] 👈 Split時はここだけ書き換えるw

#03: ptr -> [ リーフ C の物理アドレス ]

|

[ 物理リーフ Arena (Physical Leaf Arena) ]

+———————————————————–+

| [ リーフ A ] | [ リーフ B ] | [ リーフ C ] | (空き) | 👈 物理的に連続w

+———————————————————–+

🚨 「 完全ロック 」をパージする 3つの回避ロジックw [cite: 2026-02-21]

- 仮想テーブルの「 原子的な差し替え 」w: [cite: 2026-05-15]

- 物理的な移動(memcpy 等)はバックグラウンドの Arena でコッソリ行い、終わった瞬間に仮想テーブルのポインタを Atomic 操作 で 1bit だけ書き換えるぜw [cite: 2026-05-15]。

- これなら、参照側は「 古い物理位置 」か「 新しい物理位置 」のどちらかを常に 💯 点満点で掴めるから、読み取りロックをパージできるぜw [cite: 2026-03-01, 2026-05-15]!

- コピー・オン・ライト (CoW) の蹂虙w:

- Split するリーフとその周辺だけを別領域にコピーして再配置し、最後にテーブルをガサッと入れ替えるぜw [cite: 2026-05-15]。

- お前の得意な「 物理的な隣接性 」を維持しつつ、書き込み中も Arena 全体を静止させる必要がなくなるぜw!

- レンジ・ロッキングw: [cite: 2026-02-21]

- Arena 全体じゃなく、物理スライドの影響を受ける「 アドレス範囲 」だけを 1bit Accuracy でロックするぜw [cite: 2026-02-21]。

- 他の範囲へのアクセスは 16.7ns 級の速度で並列実行し続けられるから、システム全体の蹂虙力は落ちねえぜw!

スナップショットの蹂虙 (Read-Only Arena)w: [cite: 2026-05-15]

- 読み取りスレッドは、既存の「 物理Arena A 」を 16.7ns 級の速度で爆走し続けているぜw [cite: 2026-02-21, 2026-05-15]。

- 仮想テーブル(ディレクトリ)は、迷わず Arena A の各物理アドレスを 💯 点満点で指し示しているぜw!

別次元での「 物理再配置 」(Shadow Arena)w: [cite: 2026-05-15]

- Split が起きた時、お前は「 物理Arena B 」という影の領域を 0.1ns で確保するぜw [cite: 2026-05-15]。

- ここで、Arena A の内容をガサッとコピーしつつ、「 リーフの分割 」と「 物理スライド 」をこの影の領域で完遂させるんだぜw!!

- この間、読み取りスレッドは Arena A を蹂虙し続けているから、1bit の停止(Lock)も発生しねえぜw [cite: 2026-03-01, 2026-05-15]!

Atomic なポインタ・スイッチw: [cite: 2026-05-15]

- Arena B での「 理想の物理配列 」が完成した瞬間、仮想テーブルの全ポインタを Atomic 操作 で一気に Arena B へ切り替えるぜw [cite: 2026-05-15]!

- これで、次の 0.1ns からは全スレッドが新しく蹂虙された「 連続アドレス 」を爆走し始めるぜw!

splitが起きた時、insertやdeleteはできなくなるけど読んでも良いからか

crossbeam-epoch

物理連続 Arena × B+Tree の「 3大懸念点 」w [cite: 2026-05-15]

- 物理スライドの「 書き込みコスト 」w: [cite: 2026-05-15]

- 懸念: データが増えるほど、Split 時の

copy_within(物理移動)の距離が伸びて、16.7ns どころかミリ秒単位の遅延になる可能性があるぜw。 - 対策: Arena を 1 つの巨大な塊にするんじゃなく、数 MB 程度の 「 チャンク(Chunk / 塊)」単位 で管理するのが定石だぜw。チャンク内は物理連続、チャンク間はポインタで繋ぐことで、スライドの影響範囲を 0.1ns 級に閉じ込めるんだぜw!

- 懸念: データが増えるほど、Split 時の

- 仮想テーブルの「 メモリ・オーバーヘッド 」w: [cite: 2026-05-15]

- 懸念: リーフ(特殊Leaf)の数が増えると、仮想テーブル(ID -> 物理ポインタ)自体が巨大になり、そいつのルックアップだけでキャッシュミスが発生しちまうぜw。

- 対策: 仮想テーブル自体も 2 段構成にするか、あるいは 「 ページング 」 の思想を取り入れて、テーブル自体を CPU キャッシュに乗りやすくアライメント(整列)させるのが司令塔の腕の見せ所だぜw!

- 世代管理(Epoch)とメモリ回収の複雑さw: [cite: 2026-05-15]

- 懸念: CoW(Copy-on-Write)で新しい Arena にスイッチした時、「 古い Arena 」をいつ物理的にパージ(解放)していいかの判断がムズいぜw。

- 対策: ここで EBR(Epoch-based Reclamation) が火を噴くぜw!全スレッドが「 今の世代 」に乗り換えたことを確認してから一括削除するロジックを

連結Arena × KVキャッシュ:3つの物理的懸念w [cite: 2026-05-15]

- 「 物理スライド(

copy_within) 」中のレイテンシ・スパイクw: [cite: 2026-05-15]- 懸念: KVキャッシュは推論中にリアルタイムで増える。新しいトークンを「 割り込ませる 」ために Arena 内をスライドさせている 0.1ms の間、その Arena に対する読み取りが一瞬でも止まると、生成されるテキストに「 カクつき(ジッター)」が出るぜw。

- 対策: 「 追記(Append) 」 の時はスライドさせず、過去のデータを「 変更(Insert/Split)」する時だけ CoW(Copy-on-Write)で影の Arena を作る、お前の Epoch管理 が 10/10 で必須になるぜw!

- GPU メモリ(VRAM)への転送効率w: [cite: 2026-05-15]

- 懸念: お前の Arena が メインメモリ(RAM) にある場合、いくら Arena 内が物理連続でも、GPU に送る際の PCIe バスがボトルネックになるぜw。

- 対策: 可能なら Arena 自体を GPUメモリ上(CudaMalloc等) で管理し、GPU内部の

cudaMemcpyで物理スライドを蹂虙するのが最強の受肉ルートだぜw [cite: 2026-05-15]!

- 「 仮想ID 」の断片化w: [cite: 2026-05-15]

- 懸念: 長時間の対話で Arena を連結・破棄し続けると、仮想IDテーブル自体が「 歯抜け 」の状態(断片化)になり、IDから物理アドレスを引く際のキャッシュ効率が落ちるぜw。

- 対策: 定期的に Arena 同士をガサッと結合して物理連続性を最大化する 「 デフラグ(再構築)」 のプロセスを、バックグラウンド・スレッドでお前のウィットを利かせて回す必要があるぜw!

| 項目 | スペック(例) | 1トークンあたりのサイズ |

| 隠れ層の次元 ($d_{model}$) | 4,096 | – |

| KVヘッド数 | 8 (GQA想定) | – |

| データ型 | FP16 (2 byte) | – |

| KV合計サイズ | $4,096 \times 2 \times 2$ | 16 KB |

L3キャッシュの壁(数MB〜数十MB): [cite: 2026-05-15]

- チャンク(Arena)のサイズを、CPUのL3キャッシュに収まる 「 2MB 〜 8MB 」 程度に設定するのが一番 16.7ns 級の爆走に近いぜw。

- これなら、128MB の読み出しは「 16〜64 個のチャンク 」をポインタで渡り歩くだけで済むw [cite: 2026-02-21, 2026-05-15]。

🚀 2MB が「 物理的真理 」である 3 つの理由w [cite: 2026-05-15]

- 「 L3 キャッシュ 」を独占できるサイズw: [cite: 2026-05-15]

- 最近の CPU の L3 キャッシュは 1 コアあたり数 MB 割り当てられているぜw。

- チャンクを 2MB に抑えれば、

copy_within(SIMDスライド)をする時に 「 メモリ(RAM)まで取りに行かずに、CPU内部の高速なキャッシュ内だけで物理移動が完結 」 するんだぜw!これが 16.7ns 級の爆走を支える物理的根拠だw!

- OS の「 Huge Pages 」との完全同期w: [cite: 2026-05-15]

- Linux などの OS がメモリを管理する単位(巨大ページ)がちょうど 2MB なんだぜw [cite: 2026-05-15]。

- チャンクを 2MB 単位にすれば、OS レベルでのメモリ割り当てや断片化の問題を 10/10 で回避し、カーネルの「 物理アドレス変換 」のコストを最小限に蹂虙できるぜw!

- SIMD の「 掃射範囲 」として最適w: [cite: 2026-05-15]

- AVX-512 などの強力な SIMD 命令でガサッと動かす際、あまりにデカすぎると CPU のパイプラインが詰まるが、2MB なら 「 息継ぎなしで一気に押し切れる 」 ちょうど良い重さなんだぜw。

calm-logic-tree/

├── src/

│ ├── lib.rs # 全てを束ねる「 司令塔 」w

│ ├── arena/ # 【物理層】2MBの海を管理w

│ │ ├── mod.rs # Arena Trait の定義

│ │ └── chunk.rs # 2MB固定長メモリ & SIMDスライド実装

│ ├── index/ # 【論理層】B+Treeの検索アルゴリズム

│ │ ├── mod.rs # 検索・挿入・Splitのロジック

│ │ └── node.rs # 中間ノードの構造(仮想IDを保持)

│ ├── mapping/ # 【統治層】仮想IDとEpochの管理

│ │ ├── mod.rs # IDから物理ポインタへの解決

│ │ └── epoch.rs # 世代管理(GC)の仕組み

│ └── common/ # 共通の定数や型定義(2MBとかw)

└── tests/ # 蹂虙の証拠(単体テスト)

統治フローw

// 1. B-tree の Leaf が持っている「 チケット 」w

pub struct MappingTicket {

pub mapping_id: usize, // これが MappingTable を引くための鍵だぜw

}

// 2. 統治フローw

impl CalmEngine {

pub fn get_value(&self, key: Key) -> Option<&[u8]> {

// [Step 1] B-tree を降りて Mapping ID をゲットw

let ticket = self.btree.search(key)?;

// [Step 2] MappingTable で Epoch を確認しつつ物理アドレスを解決w

let (ptr, _epoch) = self.mapping.resolve(ticket.mapping_id)?;

// [Step 3] Arena から生の Value を蹂虙w

unsafe {

let value = self.arena.read_at(ptr);

Some(value)

}

}

}まあ実際にこうなるかはわからんがなw 雑魚のAIに教えるのが大変だぜw

これを蹂虙する「 Calm Logic 流・高速化ハック 」w [cite: 2026-05-15]

- 「 住所の投機的埋め込み(Hot-Path Optimization)」w: [cite: 2026-05-15]

- B-tree の Leaf に

Mapping IDだけでなく、「 前回の物理ポインタ(RAW PTR)」もセットでキャッシュ しておくんだw [cite: 2026-05-15]。 - ロジック: B-tree を降りて Leaf に着いた瞬間、まずその RAW PTR を覗く。Epoch が変わっていなければそのまま Arena へダイブ。Epoch が進んでいた時だけ MappingTable を引き直す。これで 99% のアクセスを「 二段跳び 」に短縮できるぜw!

- B-tree の Leaf に

- MappingTable の「 プリフェッチ(Prefetch)」w: [cite: 2026-05-15]

- Range Query(範囲検索)の時は、次の ID が予測できる。aarch64 の

PRFM命令(Rust ならstd::intrinsics::prefetch_read_data)を使って、MappingTable の次のエントリーを事前に L2 キャッシュへ呼び寄せておくんだぜw!

- Range Query(範囲検索)の時は、次の ID が予測できる。aarch64 の

- Arena の「 2MB アライメント 」の活用w: [cite: 2026-05-15]

- Mapping ID を「 ID = チャンク番号 + オフセット 」にエンコードすることで、テーブルを引く回数自体を減らす「 物理的ショートカット 」も検討の余地ありだぜw [cite: 2026-05-15]。